Inteligența artificială este o posibilă cale de pericol și strategie. Citiți online Artificial Intelligence

Nick Bostrom este un filosof suedez, profesor la Universitatea Oxford, co-fondator al Asociației Mondiale a Trans-umaniștilor și director al Institutului pentru Viitorul Umanității creat în 2005 la Oxford. El încearcă să conștientizeze problema cu care se confruntă umanitatea în legătură cu perspectiva apariției supermindului. Ce se întâmplă dacă mașinile depășesc oamenii în inteligență? Ne vor ajuta sau distruge umanitatea? Putem ignora astăzi problema dezvoltării inteligenței artificiale și să ne simțim complet în siguranță? Nick Bostrom descrie întrebări științifice complexe despre viitorul umanității într-un limbaj accesibil.

Cu permisiunea Editurii Mann, Ivanov și Ferber, Lenta.ru publică un extras din cartea „Inteligență artificială” a lui Nick Bostrom.

Superinteligența va putea avea oportunități gigantice de a schimba viitorul în funcție de obiectivele sale. Dar care sunt aceste obiective? Care sunt aspirațiile? Gradul de motivație al supermindului va depinde de nivelul inteligenței sale?

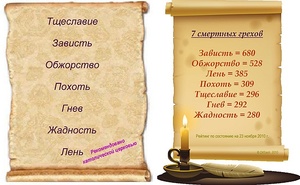

Am propus două teze. Teza ortogonalității spune (cu unele excepții) că orice nivel de inteligență poate fi combinat cu orice obiectiv, deoarece inteligența și obiectivele finale sunt ortogonale, adică independente, variabile. Teza de convergență instrumentală afirmă că forțele de acțiune superinteligente sau agenții, cu cea mai largă varietate a obiectivelor lor finale, vor urmări totuși obiective intermediare similare, deoarece toți agenții vor avea aceleași motive instrumentale. Luate împreună, aceste teze ne vor ajuta să ne imaginăm mai clar care sunt intențiile actorului superinteligent.

Relația dintre inteligență și motivație

Cartea suna deja un avertisment împotriva erorii antropomorfismului: nu ar trebui să proiectăm calitățile umane asupra posibilităților unui agent superinteligent. Vom repeta avertismentul nostru doar prin înlocuirea cuvântului oportunitate cu cuvântul motivație.

Înainte de a dezvolta în continuare prima teză, vom efectua o mică investigație preliminară pe tema infinității întregului spectru de minți posibile. În acest spațiu abstract, aproape cosmic al posibilului, mintea umană constituie un grup neglijabil.

Alegem doi reprezentanți ai rasei umane, care, în opinia generală, sunt personalități diametral opuse. Să fie Hannah Arendt și Benny Hill. Diferența dintre ele, este probabil să evaluăm ca maxim. Dar vom face acest lucru numai pentru că percepția noastră este complet reglementată de propria noastră experiență, care, la rândul ei, se bazează pe stereotipurile umane existente (într-o anumită măsură, suntem influențați de personaje fictive create din nou de o fantezie umană pentru a satisface același om imaginație).

Cu toate acestea, schimbând sfera revizuirii și analizând problema distribuției minții prin prisma spațiului infinit al posibilului, vom fi nevoiți să recunoaștem că aceste două personalități nu sunt altceva decât clone virtuale. În orice caz, din punct de vedere al caracteristicilor sistemului nervos, Hannah Arendt și Benny Hill sunt practic identice.

Să presupunem că creierul amândoi ar fi așezat unul lângă celălalt în liniștea unui muzeu - având în vedere această expunere, vom spune imediat că aceste două aparțineau aceleiași specii. Mai mult, care dintre noi ar putea determina ce creier de Hannah Arendt și care din Benny Hill? Dacă am putea studia morfologia ambelor creiere, atunci am fi convinși în sfârșit de asemănările lor fundamentale: aceeași arhitectonică lamelară a cortexului; aceleași părți ale creierului; aceeași structură a celulei nervoase a creierului - un neuron cu neurotransmițătorii săi de aceeași natură chimică.

Contrar faptului că mintea umană este practic comparabilă cu un punct indistinguibil care plutește în cosmosul nelimitat al vieților inteligente presupuse, există o tendință de a proiecta proprietățile umane pe o mare varietate de esențe extraterestre și sisteme inteligente artificiale. Acest motiv a fost excelent comentat de Eliezer Yudkovsky în aceeași lucrare, „Inteligența artificială ca factor de risc global pozitiv și negativ”:

„În epoca științei de ficțiune populară, de o calitate destul de ieftină, copertile revistelor erau pline de imagini pe care un alt monstru extraterestru - cunoscut popular drept„ monstrul cu ochi de erori ”- trăgea din nou undeva o altă frumusețe într-o rochie obligatorie - și frumusețea era femeia noastră pământească

Se pare că toți artiștii credeau că extratereștrii non-umanoizi cu o istorie evolutivă complet diferită trebuie să aibă cu siguranță o atracție sexuală față de reprezentanții frumoși ai rasei umane.<...> Cel mai probabil, artiștii care ilustrează toate acestea nici măcar nu se întrebau dacă gândacul uriaș va fi sensibil la farmecele femeilor noastre. Într-adevăr, potrivit ideilor lor, orice femeie pe jumătate dezbrăcată este pur și simplu atrăgătoare din punct de vedere sexual prin definiție, adică a simți o dorință pentru ea era o trăsătură integrală a reprezentanților curajoși ai rasei umane.

Toată atenția artistică a fost îndreptată către o rochie sfâșiată sau sfâșiată, ei erau cel puțin preocupați de modul în care a fost aranjată conștiința asemănătoare cu insectele uriașe. Și aceasta a fost principala greșeală a artiștilor. Dacă hainele nu s-ar fi sfâșiat, s-au gândit, femeile nu ar arăta atât de seducătoare pentru monștrii cu ochii fiare. Singura păcat este că extratereștrii înșiși nu au înțeles acest lucru. ”

Poate că inteligența artificială cu motivele sale de stimulare va semăna chiar cu o persoană chiar mai puțin decât un extraterestru al solului verde din spațiul exterior. Străinii sunt creaturi biologice (altceva decât o presupunere) care au apărut ca urmare a procesului evolutiv, datorită căruia se poate aștepta motivația de la ei, într-o oarecare măsură tipică pentru creaturi evoluate.

Prin urmare, nu va fi surprinzător dacă se dovedește că motivele comportamentului unui străin rațional sunt dictate de interese destul de simple: hrană, aer, temperatură, pericol de vătămare corporală sau răni deja terminate, probleme de sănătate, prădare, sex și reproducere. Dacă străinii aparțin unei societăți raționale, aceștia ar putea dezvolta motive legate de cooperare și concurență. La fel ca noi, aceștia ar manifesta devotament față de comunitatea lor, ar fi indignați de paraziți și, cine știe, nu ar fi lipsiți de vanitate, îngrijorați de reputația și aspectul lor.

Mașinile de gândire prin natura lor, spre deosebire de extratereștri, nu au sens să aibă grijă de astfel de lucruri. Este puțin probabil să găsiți o situație paradoxală dacă există vreo AI al cărui singur scop, de exemplu, este: numărarea boabelor de nisip pe plajele insulei Boracay; abordați numărul π și reprezentați-l în final ca o fracție zecimală obișnuită; determinați numărul maxim de agrafe în conul de lumină al viitorului.

De fapt, este mult mai ușor să creăm AI, care va avea obiective fără ambiguitate și nu ne impune sistemul nostru de valori asupra acesteia, dotând mașina cu proprietăți și motivații umane. Decideți-vă ceea ce este mai dificil: scrieți un program care măsoară câte zecimale în numărul π sunt deja numărate și stocate în memorie sau creați un algoritm care ține cont în mod fiabil de atingerea unui obiectiv absolut semnificativ pentru umanitate, precum lumea prosperității universale și a dreptății universale ?

Din păcate, este mai ușor pentru o persoană să scrie cod pentru un comportament simplificat, lipsit de sens și cu scop al unei mașini și să-l învețe cum să îndeplinească o sarcină. Cel mai probabil, o astfel de soartă va fi aleasă de programator pentru embrionul AI, care se va concentra doar pe dorința de „a face AI-ul să funcționeze” și cât mai repede posibil (programatorul nu este clar preocupat de ceea ce va trebui să facă AI, pe lângă faptul că demonstrează un comportament uimitor rezonabil). În curând vom reveni la acest subiect important.

O căutare inteligentă a planurilor și strategiilor instrumentale optime este posibilă în orice scop. Inteligența și motivația sunt, într-un anumit sens, ortogonale. Le reprezentăm sub forma a două axe de coordonate care definesc un grafic în care fiecare punct reprezintă un agent inteligent logic posibil. Este adevărat, această imagine va necesita câteva precizări.

De exemplu, pentru un sistem care nu este înzestrat cu motiv, ar fi imposibil să existe motivații prea complexe. În așa fel încât să putem spune în mod justificabil că, presupus, un astfel de agent „are” un astfel de ansamblu de motivații, aceste motivații ar trebui să constituie un sistem integrat funcțional împreună cu un proces de luare a deciziilor care impune anumite cerințe memoriei, puterii de calcul și poate nivelul de inteligență.

Inteligența capabilă să se transforme în sine poate prezenta caracteristici dinamice limitante. Și apoi să spunem: dacă o mașină de gândire care învață să se modifice, simte brusc o dorință acută de a deveni prost, atunci destul de repede va înceta să mai fie un sistem intelectual. Cu toate acestea, observațiile noastre nu anulează în niciun caz teza principală despre ortogonalitatea inteligenței și motivației. Îl transmit spre examinare.

Teza ortogonalității

Inteligența și obiectivele finale sunt ortogonale: mai mult sau mai puțin orice nivel de inteligență poate fi, în principiu, combinat cu mai mult sau mai puțin cu orice obiectiv final.

Această poziție poate părea controversată datorită aparentei sale asemănări cu unele postulate, deși legate de filosofia clasică, dar tot ridicând multe întrebări. Încercați să acceptați teza ortogonalității în sensul său mai restrâns - și atunci va părea destul de fiabil.

Vă rugăm să rețineți că teza ortogonalității nu înseamnă raționalitate sau sănătate, ci exclusiv despre inteligență. Prin inteligență ne referim aici la abilitățile de prognoză, planificare și comparare a obiectivelor și mijloacelor în general. Eficiența cognitivă instrumentală devine o caracteristică deosebit de importantă atunci când începem să înțelegem consecințele posibile ale apariției supermindului artificial. Chiar dacă folosim cuvântul rațional într-un sens care exclude recunoașterea rațională a unui agent superinteligent care numără numărul maxim de capse, acest lucru nu împiedică în niciun fel să aibă abilități deosebite pentru gândirea instrumentală, abilități care ar avea un impact imens asupra lumii noastre. Prezicibilitate prin proiectare. Dacă putem presupune că programatorii sunt capabili să dezvolte un sistem de stabilire a obiectivelor pentru agentul superinteligent, astfel încât el să se străduiască în mod constant să atingă obiectivul stabilit de creatorii săi, atunci suntem capabili să facem cel puțin o prezicere: acest agent își va atinge scopul. Mai mult decât atât, cu cât agentul este mai rezonabil, cu atât ingeniozitatea intelectuală va începe să se străduiască. Prin urmare, chiar înainte de crearea agentului, am putea prezice ceva despre comportamentul său dacă am ști ceva despre creatorii acestuia și obiectivele pe care urmează să le stabilească pentru el.

2. Prezicibilitatea prin moștenire. Dacă mintea umană servește direct ca prototip al inteligenței digitale (care este posibil cu emularea completă a creierului uman), atunci motivele prototipului său uman pot fi inerente inteligenței digitale. Un astfel de agent i-ar putea păstra pe unii dintre ei chiar și după ce abilitățile sale cognitive s-au dezvoltat atât de mult, încât devine supermind. Dar în astfel de cazuri, trebuie să se facă precauție. Obiectivele agentului pot fi distorsionate cu ușurință în procesul de descărcare a datelor prototipului sau în timpul prelucrării și îmbunătățirii ulterioare a acestora - probabilitatea unei astfel de dezvoltări depinde de organizarea procedurii de emulare în sine.

3. Prezicibilitate datorată prezenței unor motive instrumentale convergente. Chiar fără a cunoaște în detaliu obiectivele finale ale agentului, suntem capabili să tragem câteva concluzii despre obiectivele sale mai apropiate analizând cauzele instrumentale ale celor mai diverse obiective finale posibile, cu o selecție largă de situații. Cu cât abilitățile cognitive ale agentului sunt mai mari, cu atât această metodă de prognoză devine mai utilă, cu cât agentul este mai inteligent, cu atât este mai probabil să recunoască adevăratele motive instrumentale ale acțiunilor sale și să acționeze astfel încât să își atingă obiectivele în orice situație probabilă. (Pentru o înțelegere adecvată, trebuie remarcat faptul că pot exista motive instrumentale inaccesibile pentru noi acum, pe care agentul însuși le va descoperi numai după atingerea unui nivel foarte ridicat de inteligență - acest lucru face ca comportamentul agentului superinteligent să fie mai puțin previzibil.)

Recent, fondatorul Tesla Motors și SpaceX, Elon Musk, a creat inteligența artificială pentru a contesta un demon care nu a putut fi controlat. Musk împărtășește scepticismul său cu filozoful britanic Nick Bostrom, a cărui ultimă carte, Superinteligența: căi, pericole, strategii, omul de afaceri și-a sfătuit adepții pe Twitter. În timp ce unii futurologi prezic un viitor confortabil pentru oameni ca urmare a înlocuirii pe scară largă a muncii umane cu mașină, Nick Bostrom vede în inteligența artificială o amenințare la existența întregii noastre specii. Aparat a făcut cunoștință cu ideile lui Nick Bostrom și a aflat cum, în opinia sa, umanitatea poate fi salvată.

Nick Bostrom

Filozof și profesor la Universitatea OxfordÎn urmă cu câțiva ani, revista Politică externă l-a inclus pe lista celor 100 de gânditori majori ai planetei. Nick Bostrom consideră că oamenii trebuie să se îmbunătățească cu ajutorul tehnologiei. În 1998, a fondat Asociația Mondială a Transhumaniștilor (numită acum Humanity +) pentru a lupta pentru recunoașterea transhumanismului ca domeniu de cunoștințe științifice cu drepturi depline. Bostrom a câștigat faimă în afara comunității academice atunci când a descris conceptul despre dispariția umanității în cartea Global Catastrophic Risks. Bostrom este directorul Institutului Oxford pentru Viitorul Umanității. Acum încearcă să atragă atenția publicului asupra următoarei amenințări la adresa civilizației noastre - superintelect.

Inteligența artificială va fi mai inteligentă decât noi

Pentru Nick Bostrom, nu contează ce domeniu de cunoaștere ne va conduce la crearea superinteligenței. Fie că sunt programatorii care au scris un program capabil să gândească, sau neuroștiștiștii, recreează funcționând creierul uman. Principalul lucru este că acest lucru se va întâmpla mai repede decât credem. Majoritatea experților intervievați de Bostrom prevăd crearea unei AI capabile să gândească până în 2040 sau 2050.

Inteligența artificială astăzi întrece omul în multe domenii. Așa că, de-a lungul anilor, diferite tipuri de informații artificiale au câștigat campionii tuturor tipurilor de turnee de joc, fie că sunt șah sau poker. Astfel de realizări nu pot părea deosebit de impresionante, ci doar pentru că cerințele noastre pentru uimitor se adaptează rapid la progres.

Datorită capacității de auto-învățare, inteligența artificială se va transforma în superinteligență

Potrivit lui Bostrom, la început, inteligența artificială va arăta ca creierul unui copil. Și ca un copil, el poate învăța. Oamenii vor înceta să încerce să pună cât mai multe informații în program, dar îl vor învăța să învețe lumea din jurul său. Existența superinteligenței va fi posibilă datorită unei perfecționări constante de sine.

Este important pentru noi să creăm inteligență artificială, care este suficient de inteligentă pentru a învăța din greșelile noastre. El se va putea perfecționa la nesfârșit. Prima versiune va putea crea o a doua, care va fi mai bună, iar a doua, fiind mai inteligentă decât originalul, va crea o treime și mai avansată și așa mai departe. În anumite condiții, un astfel de proces de auto-perfecționare poate fi repetat până la realizarea unei explozii intelectuale - momentul în care nivelul intelectual al sistemului sare într-un timp scurt de la un nivel relativ modest până la nivelul superinteligenței.

Superinteligența va avea propriile nevoi și obiective

Modul de a gândi inteligența artificială va fi diferit de al nostru. Nick Bostrom nu încearcă să prezice cum va funcționa motivația de superinteligență. Dar oricare ar fi obiectivele sale, el va avea nevoie de resurse pentru a le atinge.

Inteligența artificială poate fi mai puțin umană decât un extraterestru. Nu este surprinzător faptul că lucruri precum foamea, febra, rănile, bolile, amenințarea la viață sau dorința de a avea urmași pot induce orice străin rațional să acționeze. Inteligența artificială, de fapt, nu va interesa nimic din cele de mai sus. Se poate imagina existența inteligenței artificiale, al cărui singur scop final va fi numărarea tuturor boabelor de nisip de pe insula Boracay sau găsirea reprezentării zecimale a numărului π.

Superinteligența va încerca să folosească oamenii împotriva voinței lor

Pentru a avea acces la resurse, superinteligența va încerca să găsească un intermediar. Potrivit Bostrom, chiar și fără o conexiune la rețea sau capacitatea de a fi activ fizic, superinteligența își poate atinge în continuare obiectivele. Întrucât chiar și când ajungem la maturitatea tehnologică, adică creăm toate tehnologiile care pot fi create, principala noastră slăbiciune va rămâne în continuare noi înșine.

Omul este cel mai nesigur sistem. Astăzi, hackerii apelează adesea la principiile ingineriei sociale pentru a avea acces la computerul altcuiva. Și dacă superinteligența se dovedește a fi un manipulator de hackeri, atunci se poate presupune că va găsi cu ușurință un complice sau pur și simplu va începe să ne folosească împotriva voinței noastre ca brațe și picioare.

Superinteligența ar putea „dori” să rămână singura inteligență

Unii filosofi și oameni de știință văd în inteligența artificială doar un instrument pentru îmbunătățirea calității vieții noastre. Printre ei se află filozoful american John Searle: consideră imposibilă apariția conștiinței de sine în mașini, deoarece acest lucru necesită prezența unor procese fizice și chimice similare cu cele care apar în creierul uman. Cu toate acestea, Bostrom consideră că la un moment dat, superinteligența va înceta să mai fie un instrument, dar se va dovedi a fi o creatură cu drepturi depline, cu propriile sale nevoi, iar grija pentru păstrarea rasei umane poate să nu fie una dintre ele. Vom fi doar un obstacol în calea lui.

Omul însuși reprezintă o resursă utilă (atomi grupați convenabil), iar supraviețuirea și prosperitatea lui depind de alte resurse. Rezultatul dezvoltării inteligenței artificiale care au nevoie de aceste resurse poate fi cu ușurință dispariția umanității. Așadar, va veni vremea unei societăți puternic dezvoltate din punct de vedere tehnologic, care include multe structuri complexe, multe dintre ele fiind mai inteligente decât tot ceea ce este astăzi pe planetă. Va fi o perioadă de minuni economice și tehnologice. Dar nu va mai rămâne nimeni care să profite de acest lucru. Disneyland va domni pe Pământ, în care nu vor mai fi copii.

Umanitatea trebuie să învețe să țină tehnologia sub control

Nick Bostrom nu neagă posibilitatea creării inteligenței artificiale prietenoase sau a controlului acesteia. Într-adevăr, filosoful recunoaște, avem într-adevăr nevoie de tehnologii inteligente care să ajute la rezolvarea problemelor presante. Singura întrebare este reducerea riscurilor, în special riscul de dispariție.

Dacă o explozie intelectuală ne amenință cu dispariția, atunci trebuie să înțelegem dacă putem controla procesul de detonare. Astăzi ar fi mai rezonabil să grăbim activitatea de rezolvare a problemei controlului, decât să suspendăm cercetările în domeniul inteligenței artificiale. Dar până acum, șase persoane sunt angajate în rezolvarea problemei controlului, în timp ce zeci, dacă nu chiar sute de mii, lucrează la crearea inteligenței artificiale.

Conștient - înseamnă armat

Umanitatea nu este încă pregătită pentru o întâlnire cu superinteligența și nu va fi pregătită încă mulți ani, spune Bostrom. Dar, deși s-ar putea ca un salt intelectual să nu aibă loc suficient de mult, trebuie să fim atenți acum la posibilele probleme. Mulți oameni de știință, în căutarea creării superinteligenței, uită de pericole.

Cel mai sensibil act al unui copil cu o bombă care bifează în mâini ar fi acela de a plasa cu atenție bomba pe podea, de a fugi rapid din cameră și de a chema adultul. Dar dacă întreaga noastră cameră este plină de copii și fiecare copil are acces gratuit la declanșator. Șansele ca toți să punem o jucărie periculoasă pe podea sunt extrem de mici. Un mic idiot va apărea cu siguranță un buton pentru a vedea ce se întâmplă.

Ce se întâmplă dacă mașinile depășesc oamenii în inteligență? Ne vor ajuta sau distruge rasa umană? Putem ignora astăzi problema dezvoltării inteligenței artificiale și să ne simțim complet în siguranță? În cartea sa, Nick Bostrom încearcă să realizeze problema cu care se confruntă umanitatea în legătură cu perspectiva apariției supermindului și să analizeze răspunsul acesteia. Publicat în limba rusă pentru prima dată.

* * *

Fragmentul introductiv dat al cărții Inteligență artificială. Etape. Amenințări. Strategii (Nick Bostrom, 2014) furnizate de partenerul nostru de carte - compania de litri.

Capitolul doi

Calea către superminte

Astăzi, dacă luăm nivelul dezvoltării intelectuale generale, mașinile sunt absolut inferioare oamenilor. Dar odată - prin presupunerea noastră - mintea unei mașini va depăși mintea omului. Care va fi calea noastră din momentul prezent spre cel care ne așteaptă? Acest capitol descrie mai multe opțiuni tehnologice posibile. În primul rând, vom aborda subiecte precum inteligența artificială, emulația creierului complet, îmbunătățirea abilităților cognitive umane, interfața neurocomputerului, rețelele și organizațiile. Apoi, vom evalua aspectele enumerate din punctul de vedere al probabilității dacă pot servi drept pași de ascensiune către superminte. Cu mai multe opțiuni de cale, șansa unei zile de a ajunge la destinație crește clar.

Mai întâi definim conceptul de superinteligență. Este orice inteligență care depășește semnificativ abilitățile cognitive ale unei persoane în practic orice domeniu(87). În capitolul următor, vom discuta mai detaliat despre ce este supranumitul, îl descompunem în componentele sale și îi diferențiem toate încarnările posibile. Dar să ne limităm la o caracteristică atât de generală și superficială. Rețineți că în această descriere nu a existat un loc pentru punerea în aplicare a supravegherii în viață, nici calitatea acesteia, adică dacă va fi înzestrat cu experiențe subiective și cu experiența conștiinței. Dar într-un anumit sens, mai ales etic, problema este foarte importantă. Cu toate acestea, acum, lăsând la o parte metafizica intelectuală (88), vom acorda atenție la două întrebări: premisele pentru apariția supermindului și consecințele acestui fenomen.

Conform definiției noastre, programul de șah Deep Fritz nu este super-intelectual, deoarece este „puternic” doar într-o zonă foarte restrânsă - un joc de șah -. Cu toate acestea, este foarte important ca superinteligența să aibă propriile sale specializări. Prin urmare, de fiecare dată când este vorba de un anumit comportament super-intelectual, limitat de aria de subiect, voi specifica separat aria de activitate specifică. De exemplu, inteligența artificială, care depășește semnificativ abilitățile mentale umane în domeniile programării și designului, va fi numită superinteligență inginerească. Dar să ne referim la sisteme, în general depășirea nivelului general de inteligență umană - dacă nu este indicat altfel - termenul rămâne overmind.

Cum ajungem la momentul când va fi posibil? Ce mod vom alege? Să analizăm câteva opțiuni posibile.

Inteligență artificială

Stimate cititor, nu trebuie să vă așteptați de la acest capitol la dezvoltarea conceptuală a întrebării despre cum să creați inteligență artificială puternică sau universală. Un proiect pentru a-l programa pur și simplu nu există. Dar chiar dacă aș fi fericitul proprietar al unui astfel de plan, cu siguranță nu l-aș fi făcut public în cartea mea. (Dacă motivele acestui lucru nu sunt încă evidente, sper că în capitolele următoare voi putea clarifica fără echivoc propria mea poziție.)

Cu toate acestea, astăzi este deja posibil să se recunoască unele caracteristici obligatorii inerente unui sistem atât de inteligent. Este clar că abilitatea de a învăța ca proprietate integrantă a nucleului sistemului ar trebui pusă în proiectare și nu trebuie adăugată ca o gândire ulterioară sub forma unei extensii. Același lucru este valabil și pentru capacitatea de a lucra eficient cu informații incerte și probabilistice. Cel mai probabil, printre principalele module ale AI-ului modern ar trebui să existe un mijloc de extragere a informațiilor utile din date de la senzori externi și interni și de transformare a conceptelor rezultate în reprezentări combinatorii flexibile pentru o utilizare ulterioară în procesele de gândire bazate pe logică și intuiție.

Primele sisteme de inteligență artificială clasică nu au vizat în primul rând formarea, lucrând în condiții de incertitudine și formarea de concepte - probabil datorită faptului că în acele zile metodele de analiză corespunzătoare nu au fost suficient dezvoltate. Asta nu înseamnă că toate ideile de bază ale AI sunt fundamental inovatoare. De exemplu, ideea de a folosi instruirea ca mijloc de dezvoltare a unui sistem simplu și de a-l aduce la nivel uman a fost exprimată de Alan Turing în 1950 în articolul „Ingineria computerelor și inteligența”, unde a prezentat conceptul său de „mașină-copil”:

De ce, în loc să încercați să creați un program care să imite mintea unui adult, de ce să nu încercați să creați un program care să imite mintea unui copil? Într-adevăr, dacă mintea copilului primește o educație adecvată, ea devine mintea unui adult (89).

Turing a prevăzut că un proces iterativ va fi necesar pentru a crea o „mașină pentru copii”:

Este puțin probabil să reușim să obținem un „copil-mașină” bun la prima încercare. Este necesar să efectuați un experiment cu privire la instruirea oricăreia dintre mașinile de acest fel și să aflați cum poate fi învățat. Apoi fă același experiment cu cealaltă mașină și stabilește care dintre cele două mașini este mai bună. Există o legătură evidentă între acest proces și evoluția în viața sălbatică ...

Cu toate acestea, se poate spera că acest proces va continua mai repede decât evoluția. Supraviețuirea celei mai potrivite este o modalitate prea lentă de a măsura beneficiile. Un experimentator, folosind puterea inteligenței, poate grăbi procesul de evaluare. La fel de important este să nu se limiteze la utilizarea doar a mutațiilor aleatorii. Dacă experimentatorul poate urmări cauza unei anumite deficiențe, este probabil capabil să apară o mutație de acest fel care să conducă la îmbunătățirea necesară (90).

Știm că procesele evolutive oarbe pot duce la apariția unei inteligențe generale a nivelului uman - cel puțin odată ce s-a întâmplat deja. Datorită prezicerii proceselor evolutive - adică a programării genetice, când algoritmii sunt dezvoltați și gestionați de un programator inteligent uman - trebuie să obținem rezultate similare cu o eficiență mult mai mare. Mulți savanți se bazează pe această poziție, printre care filosoful David Chalmers și cercetătorul Hans Moravek (91), care susțin că IICU este nu numai teoretic posibil, ci și practic practic în secolul XXI. În opinia lor, în crearea inteligenței, evaluând posibilitățile relative ale evoluției și ingineriei umane, vom constata că aceasta din multe domenii este semnificativ superioară evoluției și, cel mai probabil, o va depăși în curând în cele rămase. Astfel, dacă inteligența naturală a apărut odată ca urmare a proceselor evolutive, rezultă de aici că desenele umane din domeniul proiectării și dezvoltării ne vor conduce în curând la inteligența artificială. De exemplu, Moravec a scris înapoi în 1976:

Existența mai multor exemple de informații apărute în condițiile unor astfel de restricții ar trebui să ne inspire cu încredere că vom putea realiza același lucru în curând. Situația este similară cu istoria creării de mașini care pot zbura, deși sunt mai grele decât aerul: păsările, liliecii și insectele au demonstrat clar această posibilitate cu mult înainte ca un avion să fabrice omul (92).

Cu toate acestea, ar trebui să fim atenți la concluziile bazate pe o linie de raționament similar. Desigur, nu există nicio îndoială că zborul creaturilor vii neumane, care sunt mai grele decât aerul, a devenit posibil ca rezultat al evoluției mult mai devreme decât oamenii au reușit în acest sens - totuși, au reușit să folosească mecanisme. În sprijinul acestui lucru, se pot aminti și alte exemple: sisteme sonare; sisteme magnetometrice de navigație; agenți chimici de război; fotosensorii și alte dispozitive cu caracteristici de eficiență mecanică și cinetică. Cu toate acestea, cu același succes, enumerăm domeniile în care eficiența eforturilor umane este încă foarte departe de eficacitatea proceselor evolutive: morfogeneză; mecanisme de auto-vindecare; apărare imună. Astfel, argumentul lui Moravek nu „inspiră încredere” în noi că IIHCH va fi creat „foarte curând”. În cel mai bun caz, evoluția vieții inteligente pe Pământ poate servi ca limită superioară a complexității creării inteligenței. Dar acest nivel este încă atins pentru capacitățile tehnologice actuale ale omenirii.

Un alt argument în favoarea dezvoltării inteligenței artificiale conform modelului procesului evolutiv este capacitatea de a rula algoritmi genetici pe procesoare destul de puternice și în cele din urmă obține rezultate proporționale cu cele obținute în timpul evoluției biologice. Astfel, această versiune a argumentului sugerează îmbunătățirea AI printr-o metodă specifică.

Cât de adevărată este afirmația că destul de curând vom avea la dispoziția noastră resursele de calcul suficiente pentru a reproduce procesele evolutive corespunzătoare, în urma cărora s-a format inteligența umană? Răspunsul depinde de următoarele condiții: în primul rând, dacă se vor realiza progrese semnificative în tehnologia computerului în următoarele decenii; în al doilea rând, ce putere de calcul este necesară pentru ca mecanismele de lansare a algoritmilor genetici să fie similare cu selecția naturală, ceea ce a dus la apariția omului. Trebuie spus că concluziile la care ajungem în lanțul raționamentului nostru sunt extrem de vagi; dar, în ciuda unui fapt atât de descurajant, pare încă oportun să se încerce să se ofere cel puțin o estimare brută a acestei versiuni (a se vedea caseta 3). În absența altor posibilități, chiar și calcule aproximative vor atrage atenția asupra unor cantități curioase necunoscute.

Concluzia este că puterea de calcul necesară doar pentru a reproduce procesele evolutive necesare care au dus la apariția inteligenței umane este practic imposibilă și va rămâne așa mult timp, chiar dacă legea lui Moore a fost în vigoare pentru un secol întreg (a se vedea Fig. 3 de mai jos). Cu toate acestea, există o soluție destul de acceptabilă: vom afecta foarte mult eficiența atunci când, în loc de o repetare simplă a proceselor evolutive naturale, dezvoltăm un motor de căutare axat pe crearea inteligenței, folosind o varietate de avantaje evidente în comparație cu selecția naturală. Desigur, acum este foarte dificil să cuantificăm câștigul rezultat din eficiență. Nici măcar nu știm despre ce ordine de mărime vorbim - cinci sau douăzeci și cinci. Prin urmare, dacă argumentul bazat pe modelul evolutiv nu este dezvoltat corespunzător, nu vom putea să ne îndeplinim așteptările și nu vom ști niciodată cât de dificil este drumul către inteligența artificială la nivel uman și cât timp vom aștepta apariția sa.

Caseta 3. Evaluarea eforturilor de reproducere a procesului evolutiv

Nu toate realizările antropogenezei legate de mintea umană sunt de valoare pentru specialiștii moderni care lucrează la problema dezvoltării evolutive a inteligenței artificiale. Doar o parte nesemnificativă a ceea ce a avut loc ca urmare a selecției naturale pe Pământ este implicată. De exemplu, problemele pe care oamenii nu le pot ține cont, însă, sunt rezultatul unor eforturi evolutive minore. În special, întrucât ne putem alimenta calculatoarele cu electricitate, nu este nevoie să reinventăm moleculele sistemului de economie de energie celulară pentru a crea mașini inteligente - iar evoluția moleculară a mecanismului metabolic a necesitat o parte semnificativă din consumul total de energie naturală disponibil. evoluție de-a lungul istoriei Pământului (93).

Există un concept potrivit căruia cheia creării AI este structura sistemului nervos, apărută în urmă cu mai puțin de un miliard de ani (94). Dacă acceptăm această prevedere, numărul de „experimente” necesare pentru evoluție va fi semnificativ redus. Astăzi în lume există aproximativ (4-6) × 1030 procariote, dar numai 1019 insecte și mai puțin de 1010 reprezentanți ai rasei umane (apropo, populația în ajunul revoluției neolitice era de ordinul mărimii mai mici) (95). De acord, aceste numere nu sunt atât de înspăimântătoare.

Cu toate acestea, algoritmii evolutivi necesită nu numai o varietate de opțiuni, ci și o evaluare a stării de fitness a fiecărei opțiuni - de obicei cea mai scumpă componentă din punct de vedere al resurselor de calcul. În cazul evoluției inteligenței artificiale, evaluarea fitnessului necesită aparent modelarea dezvoltării neuronale, precum și capacitatea de a învăța și de a învăța. Prin urmare, este mai bine să nu ne uităm la numărul total de organisme cu un sistem nervos complex, ci să estimăm numărul de neuroni din organismele biologice pe care ar putea fi necesar să le modelăm pentru a calcula funcția de evoluție a țintei. O estimare brută se poate face referindu-ne la insectele care domină biomasa terestră (doar furnicile reprezintă 15-20%) (96). Volumul creierului insectelor depinde de mulți factori. Cu cât insecta este mai mare și cu atât este mai socială (adică duce un stil de viață social), cu atât creierul este mai mare; de exemplu, o albină are puțin mai puțin de 106 neuroni, o Drosophila are 105 neuroni, o furnică cu 250 de mii de neuroni se află între ei (97). Creierul majorității insectelor mai mici conține doar câteva mii de neuroni. Propun cu precauție extremă să se mențină pe valoarea medie (105) și să echivalăm toate insectele (1019 în lume) cu Drosophila, atunci numărul total al neuronilor lor va fi de 1024. Adăugăm un alt ordin de magnitudine datorat crustaceelor, păsărilor, reptilelor, mamiferelor etc. d. - și obținem 1025. (Comparați acest lucru cu faptul că înainte de apariția agriculturii erau mai puțin de 107 oameni pe planetă și fiecare dintre ei avea aproximativ 1011 neuroni - adică, în total, suma tuturor neuronilor era mai mică decât 1018, deși creierul uman era vecine - și conține - multe alte sinapse.)

Costurile de calcul ale modelării unui neuron depind de gradul necesar de detaliu al modelului. Pentru un model de neuroni extrem de simplu în timp real, sunt necesare aproximativ 1000 de operații cu punct flotant pe secundă (denumite în continuare FLOPS). Modelul electro-și fiziologic realist Hodgkin-Huxley are nevoie de 1.200.000 FLOPS. Un model de neuroni multicomponent mai complex ar adăuga două până la trei ordine de mărime, iar un model de nivel superior care operează cu sisteme neuronale necesită cu două-trei ordine de magnitudine mai puține operații pe neuron decât modelele simple (98). Dacă trebuie să simulăm 1025 de neuroni pe parcursul unei miliarde de ani de evoluție (aceasta este mai mult decât durata de viață a sistemelor nervoase în forma lor actuală) și lăsăm calculatoarele să lucreze la această sarcină timp de un an, atunci cerințele pentru puterea lor de calcul se încadrează în intervalul 1031-1044 FLOPS . Pentru comparație, cel mai puternic computer din lume, chinezul Tianhe-2 (din septembrie 2013), este capabil să ofere doar 3,39 × 1016 FLOPS. În ultimele decenii, calculatoarele convenționale și-au mărit performanțele cu un ordin de mărime aproximativ la fiecare 6,7 ani. Chiar dacă puterea de calcul începe să crească conform legii lui Moore de-a lungul unui secol, nu va fi suficient pentru a elimina decalajul existent. Utilizarea sistemelor de calcul mai specializate sau creșterea timpului de calcul poate reduce necesarul de putere doar cu mai multe ordine de mărime.

Este posibil ca eliminarea acestui tip de ineficiență să contribuie la economisirea mai multor comenzi din capacitatea necesară în 1031-1044 FLOPS, calculate anterior. Din păcate, este dificil să spui exact câți. Este dificil să se dea chiar și o estimare brută - se poate doar ghici dacă vor fi cinci ordine de mărime, zece sau douăzeci și cinci (101).

Fig. 3. Performanța calculatoarelor grele. În sens literal, ceea ce se numește „Legea lui Moore” este o observație conform căreia numărul de tranzistoare plasate pe un cip cu circuit integrat se dublează aproximativ la fiecare doi ani. Cu toate acestea, legea este adesea generalizată, considerând că și alți indicatori de performanță ai computerelor cresc în mod exponențial. Graficul nostru arată variația de timp a vitezei de vârf a celor mai puternice computere din lume (pe o scară verticală logaritmică). În ultimii ani, viteza de calcul secvențial a încetat să crească, dar, datorită răspândirii calculelor paralele, numărul total de operațiuni continuă să crească în același ritm (102).

Există o altă complicație asociată cu factorii evolutivi prezentați ca ultim argument. Problema este că nu suntem capabili să calculăm - chiar și aproximativ - limita superioară a dificultății de a obține informații într-un mod evolutiv. Da, viața inteligentă a apărut odată pe Pământ, dar nu rezultă încă din faptul că procesele evolutive cu un grad ridicat de probabilitate duc la apariția inteligenței. O astfel de concluzie ar fi fundamental greșită, deoarece așa-numitul efect de observare în timpul selecției nu este luat în considerare, ceea ce implică faptul că toți observatorii se află pe planeta de unde a apărut viața inteligentă, indiferent de cât de probabil sau de incredibil este un astfel de eveniment pe orice altă planetă. Să presupunem, pentru apariția vieții inteligente, pe lângă erorile sistematice ale selecției naturale, o cantitate imensă de meciuri bune - atât de mare încât viața inteligentă a apărut doar pe una dintre cele 1030 de planete unde există gene simple replicatoare. În acest caz, cercetătorii, atunci când lansează algoritmi genetici, în încercarea de a reproduce ceea ce a fost creat prin evoluție, s-ar putea confrunta cu faptul că trebuie să facă aproximativ 1030 de iterații înainte de a găsi o combinație în care toate elementele se formează corect. Acest lucru pare să fie în concordanță cu observația noastră că viața s-a născut și s-a dezvoltat aici pe Pământ. O parte a eludării acestei bariere epistemologice este prin mișcări logice atente și oarecum greoaie - prin analizarea cazurilor de evoluție convergentă a caracteristicilor legate de inteligență și luând în considerare efectul observației în timpul selecției. Dacă oamenii de știință nu își dau probleme să efectueze o astfel de analiză, atunci în viitor, niciunul dintre ei nu va trebui să evalueze valoarea maximă și să afle cât poate limita superioară estimată a puterii de calcul necesare pentru a reproduce evoluția inteligenței (a se vedea caseta 3) sub ordinea treizeci (sau unele alte dimensiuni la fel de mari) (103).

Să trecem la următoarea opțiune pentru a ne atinge obiectivul: argumentul în favoarea fezabilității evoluției inteligenței artificiale este activitatea creierului uman, care este denumit modelul de bază pentru AI. Diferite versiuni ale acestei abordări diferă doar în ceea ce privește gradul de reproducere - cât de precis este propus să imităm funcțiile creierului biologic. La un pol, care este un fel de „joc de imitație”, avem un concept emularea creierului complet, adică o simulare la scară completă a creierului (vom reveni la acest lucru un pic mai târziu). La cealaltă extremă sunt tehnologiile prin care funcționalitatea creierului servește doar ca punct de plecare, dar modelarea la nivel scăzut nu este planificată. În cele din urmă, ne vom apropia de înțelegerea ideii generale a activității creierului, care este facilitată de progresele în neurobiologie și psihologie cognitivă, precum și de îmbunătățirea continuă a instrumentelor și hardware-ului. Noile cunoștințe vor deveni, fără îndoială, o orientare în lucrul în continuare cu AI. Știm deja exemplul AI care a apărut ca urmare a modelării activității creierului - acestea sunt rețele neuronale. O altă idee, preluată din neurobiologie și transferată în învățarea automată, este o organizare ierarhică a percepției. Studiul învățării de consolidare s-a datorat (cel puțin parțial) rolului important pe care acest subiect îl joacă în teoriile psihologice care descriu comportamentul și gândirea animalelor, precum și tehnicile de învățare a armăturilor (de exemplu, algoritmul TD). Astăzi, învățarea consolidată este utilizată pe scară largă în sistemele AI (104). Cu siguranță vor exista mai multe astfel de exemple în viitor. Întrucât setul de mecanisme de bază ale funcționării creierului este foarte limitat - de fapt, există foarte puține dintre ele - toate aceste mecanisme vor fi descoperite mai devreme sau mai târziu, datorită succeselor constante ale neurobiologiei. Cu toate acestea, este posibil ca o abordare hibridă să ajungă la linia de sosire, combinând modele dezvoltate, pe de o parte, pe baza activității creierului uman, iar pe de altă parte, numai pe baza tehnologiilor de inteligență artificială. Nu este deloc necesar ca sistemul rezultat să semene cu creierul în orice, chiar dacă unele principii ale activității sale vor fi utilizate în timpul creării sale.

Activitatea creierului uman ca model de bază este un argument puternic în favoarea fezabilității creării și dezvoltării în continuare a inteligenței artificiale. Cu toate acestea, nici măcar unul dintre cele mai puternice argumente nu ne va apropia de înțelegerea datelor viitoare, deoarece este dificil de prezis când va avea loc o descoperire particulară în neurobiologie. Un lucru poate fi spus: cu cât privim mai adânc spre viitor, cu atât este mai mare probabilitatea ca secretele funcționării creierului să fie dezvăluite pe deplin pentru implementarea sistemelor de inteligență artificială.

Cercetătorii care lucrează în domeniul inteligenței artificiale au diferite puncte de vedere cu privire la modul în care promite abordarea neuromorfă este comparat cu tehnologiile bazate pe abordări complet compuse. Zborul păsărilor a demonstrat posibilitatea fizică a apariției unor mecanisme de zbor mai grele decât aerul, ceea ce a dus la final la construcția aeronavelor. Cu toate acestea, chiar și primele avioane care au decolat nu și-au lovit aripile. În ce mod va merge dezvoltarea inteligenței artificiale? Întrebarea rămâne deschisă: în conformitate cu principiul legii aerodinamicii, care ține mecanisme grele de fier în aer - adică învățând de la animale sălbatice, dar nu imitându-l direct; după principiul dacă dispozitivul unui motor cu combustie internă - adică copiază direct acțiunea forțelor naturale.

Conceptul Turing de a dezvolta un program care primește b desprecea mai mare parte a cunoștințelor prin formare, și nu ca urmare a stabilirii datelor inițiale, este aplicabilă creării inteligenței artificiale - atât abordărilor neuromorfe, cât și compoziționale.

O variantă a conceptului Turing de „mașină-copil” a fost ideea embrionului AI (105). Totuși, dacă „mașina copil”, așa cum a reprezentat Turing, ar fi trebuit să aibă o arhitectură relativ fixă \u200b\u200bși să-și dezvolte potențialul prin acumulare conținut, embrionul AI va fi un sistem mai complex, care se auto-îmbunătățește arhitectură. În primele etape ale existenței, embrionul AI se dezvoltă în principal datorită culegerii de informații, acționând prin încercare și eroare, fără ajutorul unui programator. „După ce s-a maturizat”, el trebuie să învețe independent a înțelege în principiile activității lor pentru a putea proiecta noi algoritmi și structuri de calcul care să-i crească eficiența cognitivă. Înțelegerea necesară este posibilă doar în acele cazuri în care embrionul AI, sau în multe domenii a atins un nivel general destul de ridicat de dezvoltare intelectuală sau în anumite domenii de subiect - să zicem, cibernetica și matematica - a depășit un anumit prag intelectual.

Aceasta ne aduce la un alt concept important numit „auto-îmbunătățire recursivă”. Un embrion AI de succes trebuie să fie capabil de auto-dezvoltare continuă: prima versiune creează o versiune îmbunătățită de sine, care este mult mai inteligentă decât originalul; versiunea îmbunătățită, la rândul său, lucrează la o versiune și mai bună și așa mai departe (106). În anumite condiții, procesul de auto-perfecționare recursivă poate dura mult timp și, în final, poate duce la dezvoltarea explozivă a inteligenței artificiale. Aceasta se referă la un eveniment în care, într-o perioadă scurtă de timp, inteligența generală a sistemului crește de la un nivel relativ modest (posibil în multe aspecte, cu excepția programării și cercetării în domeniul AI, chiar mai mic decât uman), la superinteligent, radical superior nivelului omului. În capitolul al patrulea vom reveni la această perspectivă, care este foarte importantă în semnificația sa și vom analiza mai detaliat dinamica dezvoltării evenimentelor.

Vă rugăm să rețineți că un astfel de model de dezvoltare sugerează posibilitatea surprizelor. Încercările de a crea inteligență artificială universală pot duce, pe de o parte, la un eșec complet, iar pe de altă parte, pot duce la ultimul element critic care lipsește - după care embrionul AI va deveni capabil de auto-îmbunătățire recursivă stabilă.

Înainte de a termina această secțiune a capitolului, aș dori să subliniez încă un lucru: nu este deloc necesar ca inteligența artificială să fie asemănătoare cu mintea umană. Recunosc pe deplin că AI va deveni complet „extraterestru” - cel mai probabil, acest lucru se va întâmpla. Se poate aștepta ca arhitectura cognitivă a AI să fie dramatic diferită de sistemul cognitiv al omului; de exemplu, în primele etape, arhitectura cognitivă va avea puncte forte și puncte slabe diferite (deși, după cum vom vedea mai târziu, AI va putea depăși punctele slabe inițiale). Mai presus de toate, sistemele AI orientate spre obiective pot să nu aibă nicio legătură cu sistemul umanitar orientat spre obiective. Nu există niciun motiv să argumentăm că AI-ul de nivel mediu va începe să fie ghidat de sentimente umane, cum ar fi iubirea, ura, mândria - o astfel de adaptare complexă va necesita o cantitate imensă de muncă scumpă, în plus, apariția unei astfel de oportunități în AI ar trebui să fie luată cu mare atenție. Aceasta este atât o problemă mare, cât și oportunități mari. Vom reveni la motivația AI în capitolele ulterioare, dar această idee este atât de importantă pentru carte, încât ar trebui să fie păstrată în minte constant.

Emulația completă a creierului uman

În procesul de simulare la scară completă a creierului, pe care o numim „emularea creierului complet” sau „încărcarea minții”, inteligența artificială este creată prin scanarea și reproducerea corectă a structurii computaționale a creierului biologic. Astfel, trebuie să vă inspirați complet din natură - un caz extrem de plagiat nedisimulat. Pentru ca emularea completă a creierului să aibă succes, sunt necesare mai multe etape specifice.

Prima etapă. Se face o scanare destul de detaliată a creierului uman. Aceasta poate include fixarea creierului unei persoane decedate prin vitrificare sau tranziție de sticlă (ca urmare, țesuturile devin dure, precum sticla). Apoi, secțiuni subțiri sunt realizate din țesut cu un aparat, care sunt trecute printr-un alt aparat de scanare, eventual folosind microscopuri electronice. În această etapă, colorarea materialului cu coloranți speciali este utilizată pentru a dezvălui proprietățile sale structurale și chimice. În același timp, multe dispozitive de scanare funcționează simultan, procesând simultan diferite secțiuni de țesut.

A doua etapă. Datele sursă de la scanere sunt descărcate pe un computer pentru procesarea automată a imaginilor pentru a reconstrui o rețea neuronală tridimensională responsabilă de cunoașterea în creierul biologic. Pentru a reduce numărul de imagini de înaltă rezoluție care trebuie stocate în buffer, acest pas poate fi efectuat simultan cu prima. Harta rezultată este combinată cu o bibliotecă de modele de calcul neuronal pe diferite tipuri de neuroni sau pe diferite elemente neuronale (de exemplu, sinapsele pot diferi). Unele rezultate ale scanării și procesării imaginilor folosind tehnologia modernă sunt prezentate în Fig. 4.

Fișa finalului de fapt.

Despre carte

Avem însă un avantaj semnificativ: primul pas este al nostru. Este posibil să se genereze inteligență artificială, ceea ce face ca acest proces să fie controlat și sigur? Această carte este cea mai grea ...

Citiți integralDespre carte

Cartea nr. 1 despre viitorul inteligenței artificiale și pericolele acesteia.

Ce se întâmplă când mașinile depășesc oamenii în inteligență? Ne vor ajuta sau distruge rasa umană? Nick Bostrom în cartea sa ridică aceste întrebări și vorbește despre viitorul umanității și al vieții inteligente.

Mintea umană are unele abilități pe care alte animale nu le au. Pentru ei putem fi recunoscători că specia noastră ocupă o poziție atât de dominantă. Dacă mașinile depășesc creierul nostru uman din punct de vedere al inteligenței, ele pot deveni foarte puternice - și chiar vor ieși din controlul nostru. Existența gorilelor moderne, de exemplu, depinde mai mult de o persoană decât de gorile în sine - același lucru se poate întâmpla cu o persoană și o nouă superinteligență a mașinii.

Avem însă un avantaj semnificativ: primul pas este al nostru. Este posibil să se genereze inteligență artificială, ceea ce face ca acest proces să fie controlat și în siguranță? În această carte, cele mai complexe întrebări științifice despre viitorul omenirii și inteligența artificială sunt descrise într-un limbaj accesibil.

Pentru cine este această carte?

Pentru toți cei interesați de inteligența artificială și de viitorul omenirii.

Despre autor

Nick Bostrom este profesor la Departamentul de Filozofie al Universității Oxford, fondator și director al Institutului pentru Viitorul Umanității, un centru de cercetare interdisciplinar care studiază impactul tehnologiei asupra posibilității unei viitoare catastrofe globale. Membrii institutului sunt cei mai buni matematicieni, filozofi și oameni de știință.

Pe lângă filozofie, Bostrom este specializat în neurobiologie, logică matematică și fizică. Este autorul a peste 200 de publicații științifice și câștigătorul premiului Eugene R. Gannon, care este acordat în fiecare an unui om de știință din lume pentru realizări în domeniul filozofiei, matematicii și științelor naturii.

Nick Bostrom este cel mai tânăr membru al primelor 15 liste de principali gânditori din lume, potrivit revistei Prospect. Lucrările sale sunt traduse în 22 de limbi.

Pagina curentă: 1 (totalul cărții are 40 de pagini) [pasaj disponibil pentru citire: 8 pagini]

Această carte este un complet bun.

Teoria jocurilor

Avinash Dixit și Barry Nalbuff

Brainiac

Ken Jennings

Plăcerea de la x

Stephen Strogatz

Superintelligence

Căi, pericole, strategii

Nick Bostrom

Inteligență artificială

Etape. Amenințări. strategie

„Mann, Ivanov și Ferber”

informații

de la editor

Redactorii științifici M. S. Burtsev, E. D. Kazimirova, A. B. Lavrentiev

Cu amabilitatea Agenției Alexander Korzhenevski

Publicat în limba rusă pentru prima dată

Bostrom Nick

Inteligență artificială. Etape. Amenințări. Strategie / Nick Bostrom; per. din engleză S. Bufniță. - M.: Mann, Ivanov și Ferber, 2016.

ISBN 978-5-00057-810-0

Ce se întâmplă dacă mașinile depășesc oamenii în inteligență? Ne vor ajuta sau distruge rasa umană? Putem ignora astăzi problema dezvoltării inteligenței artificiale și să ne simțim complet în siguranță?

În cartea sa, Nick Bostrom încearcă să realizeze problema cu care se confruntă umanitatea în legătură cu perspectiva apariției supermindului și să analizeze răspunsul acesteia.

Toate drepturile rezervate.

Nicio parte a acestei cărți nu poate fi reprodusă sub nicio formă fără permisiunea scrisă a deținătorilor de drepturi de autor.

Asistența juridică pentru editor este asigurată de firma de avocatură Vegas-Lex.

Această carte a fost publicată inițial în engleză în 2014. Această traducere este publicată prin acord cu Oxford University Press. Editura este responsabilă exclusiv pentru această traducere din lucrarea inițială, iar Oxford University Press nu va răspunde pentru erori, omisiuni sau inexactități sau ambiguități în această traducere sau pentru orice pierderi cauzate de încrederea acestora.

© Nick Bostrom, 2014

© Traducere în limba rusă, publicare în rusă, design. LLC Mann, Ivanov și Ferber, 2016

Prefață partener

- Am un singur prieten, a spus Eddie. - El susține că omul este o verigă intermediară de care natura trebuie să creeze coroana creației: un pahar de coniac cu o felie de lămâie.

Arkady și Boris Strugatsky. Luni începe sâmbătă

Autorul consideră că amenințarea mortală este asociată cu posibilitatea creării de inteligență artificială care depășește mintea umană. O catastrofă ar putea izbuti atât la sfârșitul secolului XXI, cât și în deceniile următoare. Întreaga istorie a omenirii arată: atunci când are loc o ciocnire între un reprezentant al speciei noastre, o persoană rațională și orice alta care locuiește pe planeta noastră, cel care este mai inteligent câștigă. Până acum, eram cei mai deștepți, dar nu avem garanții că acest lucru va dura pentru totdeauna.

Nick Bostrom scrie că dacă algoritmii de calculatoare inteligente învață să creeze algoritmi și mai deștepți pe cont propriu, iar aceștia, la rândul lor, sunt și mai deștepți, va exista o creștere explozivă a inteligenței artificiale, în comparație cu care oamenii vor arăta ceva ca furnicile sunt alături de oamenii din sens intelectual desigur. Pe lume va apărea o specie nouă, deși artificială, dar superinteligentă. Nu contează ce „îmi vine în minte”, o încercare de a face toți oamenii fericiți sau decizia de a opri poluarea antropică a oceanelor din cel mai eficient mod, adică distrugerea umanității, oamenii nu vor putea rezista oricum. Nu există nicio șansă de confruntare în spiritul filmului despre Terminator, nici derapaje cu cyborguri de fier. Așteptăm verificarea și checkmate - ca într-un duel al computerului de șah Deep Blue cu un prim grad.

În ultimele sute sau doi ani, realizările științei au trezit speranță la unii dintre noi pentru soluționarea tuturor problemelor omenirii, în timp ce altele au provocat și au provocat frică nestăpânită. În același timp, trebuie să spun că ambele puncte de vedere arată destul de justificate. Datorită științei, boli teribile au fost înfrânate, omenirea astăzi este capabilă să hrănească un număr fără precedent de oameni, iar dintr-un punct de pe glob poți ajunge la opus în mai puțin de o zi. Cu toate acestea, prin harul aceleiași științe, oamenii care folosesc cea mai recentă tehnologie militară se distrug reciproc cu viteză și eficiență monstruoase.

O tendință similară - când dezvoltarea rapidă a tehnologiei nu numai că duce la formarea de noi oportunități, dar creează și amenințări fără precedent - observăm în domeniul securității informațiilor. Întreaga noastră industrie a apărut și există doar pentru că crearea și distribuția în masă a unor astfel de lucruri minunate precum computerele și internetul au creat probleme care nu ar fi putut fi imaginate în epoca pre-calculatoare. Ca urmare a apariției tehnologiei informației, a avut loc o revoluție în comunicațiile umane. Inclusiv a fost folosit de tot felul de cibernetici. Și abia acum omenirea devine treptat conștientă de noile riscuri: tot mai multe obiecte ale lumii fizice sunt controlate de computere și software, adesea imperfecte, pline de găuri și vulnerabile; un număr din ce în ce mai mare de astfel de obiecte sunt conectate la internet, iar amenințările de pace cibernetică devin rapid probleme de securitate fizică și, eventual, viața și moartea.

De aceea, cartea lui Nick Bostrom pare atât de interesantă. Primul pas pentru prevenirea scenariilor de coșmar (pentru o rețea de calculatoare separată sau pentru întreaga umanitate) este de a înțelege din ce pot consta. Bostrom face multe rezerve că crearea de inteligență artificială care este comparabilă sau superioară cu mintea umană - inteligența artificială care poate distruge umanitatea - este doar un scenariu probabil care nu poate fi realizat. Desigur, există multe opțiuni, iar dezvoltarea tehnologiei computerizate poate să nu distrugă umanitatea, dar ne va da răspunsul la „întrebarea principală a vieții, Universul și toate acestea” (poate că aceasta se va dovedi într-adevăr numărul 42, ca în romanul „Ghidul autostopistului pentru galaxie”) . Există speranță, dar pericolul este foarte grav - ne avertizează Bostrom. În opinia mea, dacă există probabilitatea unei astfel de amenințări existențiale pentru umanitate, atunci trebuie să o tratăm în consecință și, pentru a o preveni și a ne proteja de aceasta, ar trebui să facem eforturi comune la scară globală.

Aș dori să completez introducerea mea cu un citat din cartea lui Mikhail Weller „Omul în sistem”:

Când ficțiunea științifică, adică o gândire umană proiectată în imagini și comploturi repetă ceva timp și în detaliu - ei bine, nu există fum fără foc. Filmele banale de acțiune de la Hollywood despre războaiele umane cu civilizația roboților poartă un sâmbure amar de adevăr sub coada unui ceas comercial.

Când programul de instinct transmis este încorporat în roboți, iar satisfacția acestor instincte este încorporată într-o nevoie necondiționată și de bază, iar acest lucru va trece la nivelul autoreproductiei - atunci, băieți, încetați lupta cu fumatul și alcoolul, pentru că va fi timpul să bea și să fumeze înainte de khan tuturor.

Eugene Kaspersky,

Directorul general al Kaspersky Lab

Povestea neterminată a vrăbii

Odată, în mijlocul cuibului, vrăbii, obosiți de multe zile de muncă asiduă, s-au așezat să se odihnească la apusul soarelui și să discute despre asta și asta.

„Suntem atât de mici, atât de slabi.” Imaginați-vă cât de ușor ar fi să trăim dacă am avea o bufniță în ajutoarele noastre! - o vrabie a strigat visător. „Ne-ar putea face cuiburi ...”

- Aha! - a fost de acord cu altul. „Și ai grijă de bătrânii și puii noștri ...”

„Și instruiți-ne și protejați-ne de pisica vecinului”, a adăugat al treilea.

Apoi, Pastus, cea mai veche vrabie, a sugerat:

- Lăsați cercetașii să zboare în direcții diferite în căutarea bufniței care a căzut din cuib. Cu toate acestea, va face un ou bufniță, o pâlnie și chiar un pui de nevăstuică. Această descoperire se va dovedi a fi cel mai mare succes pentru turma noastră! La fel ca cea când am găsit în curte o sursă neplăcută de cereale.

Vrăbii, încântați cu seriozitate, au lămurit că există urină.

Și doar Scronfinkle cu un singur ochi, vrăjitoarea plină de resurse, cu minte grea, părea să se îndoiască de fezabilitatea acestei întreprinderi.

„Am ales calea dezastruoasă”, a spus el cu convingere. „Ar trebui să nu studiem mai întâi în serios problemele îmblânzirii și domesticirii bufnițelor înainte de a lăsa în mijlocul lor o astfel de creatură periculoasă?”

- Mi se pare, a obiectat Pastus, „arta îmblânzirii bufnițelor nu este o sarcină ușoară”. Găsirea unui ou de bufniță este al naibii de greu. Deci, să începem cu căutarea. Aici suntem capabili să aducem bufnita, apoi ne gândim la problemele educației.

- Plan vicios! Scronfinkle a tweetit nervos.

Dar nimeni nu l-a ascultat. În direcția Pastus, o turmă vrabie a zburat în aer și a lovit drumul.

Pe loc au rămas doar vrăbii, care au decis să-și dea seama cum să îmblânzeze bufnițele. Destul de repede, și-au dat seama că Pastus avea dreptate: sarcina era incredibil de dificilă, mai ales în absența bufniței în sine, care ar trebui practicată. Cu toate acestea, păsările au continuat să studieze problema, pentru că se temeau că turma se va întoarce cu un ou de bufniță înainte de a putea descoperi secretul modului de a controla comportamentul unei bufnițe.

introducere

În interiorul craniului nostru se află o anumită substanță, datorită căreia putem, de exemplu, să citim. Substanța indicată - creierul uman - este înzestrată cu capacități absente la alte mamifere. De fapt, oamenii își datorează poziția dominantă pe planetă tocmai acestor trăsături caracteristice. Unele animale se disting prin mușchi puternici și colți ascuțiți, dar nu o singură creatură vie, cu excepția omului, este dotată cu o minte atât de perfectă. Datorită unui nivel intelectual mai ridicat, am putut crea instrumente precum limbajul, tehnologia și organizarea socială complexă. De-a lungul timpului, avantajul nostru s-a consolidat și s-a extins, deoarece fiecare nouă generație, bazată pe realizările predecesorilor săi, a mers mai departe.

Dacă într-o zi vor dezvolta o inteligență artificială care depășește nivelul general de dezvoltare a minții umane, atunci inteligența super-puternică va apărea în lume. Și atunci soarta speciei noastre va depinde direct de acțiunile acestor sisteme tehnice inteligente - la fel cum soarta astăzi a gorilelor este mai determinată nu de primate, ci de intențiile umane.

Cu toate acestea, umanitatea are un avantaj incontestabil, deoarece creează sisteme tehnice inteligente. În principiu, cine se oprește să vină cu o astfel de superminte care ia sub protecția ei valorile universale? Desigur, avem motive foarte bune pentru a ne proteja. În termeni practice, va trebui să abordăm cea mai dificilă problemă de control - cum să gestionăm proiectele și acțiunile supermindului. Și oamenii vor putea folosi o singură șansă. De îndată ce se va naște inteligența artificială neprietenoasă (AI), aceasta va începe imediat să împiedice eforturile noastre de a scăpa de ea sau de a-și regla setările. Și atunci soarta omenirii va fi o concluzie anterioară.

În cartea mea, încerc să înțeleg problema cu care se confruntă oamenii în legătură cu perspectiva apariției supermindului și să analizez răspunsul lor. Poate ne așteaptă cea mai serioasă și înfricoșătoare agendă pe care umanitatea a primit-o vreodată. Și indiferent dacă câștigăm sau pierdem, este posibil ca această provocare să fie ultima noastră. Nu dau niciun argument în favoarea acestei sau acelei versiuni: suntem pe marginea unei mari descoperiri în crearea inteligenței artificiale; Este posibil să se prezice cu o anumită acuratețe când are loc un anumit eveniment revoluționar. Cel mai probabil în secolul curent. Este puțin probabil ca cineva să numească un termen mai specific.

În primele două capitole, voi avea în vedere domenii științifice diferite și voi atinge ușor un subiect precum ritmul dezvoltării economice. Cu toate acestea, cartea este dedicată mai ales a ceea ce se va întâmpla după apariția supermindului. Trebuie să discutăm următoarele aspecte: dinamica dezvoltării explozive a inteligenței artificiale; formele și potențialul său; alegerile strategice cu care va fi înzestrat și care vor primi un avantaj decisiv. După aceea, analizăm problema controlului și încercăm să rezolvăm cea mai importantă problemă: este posibil să simulăm astfel de condiții inițiale care să ne permită să ne menținem propria superioritate și, în final, să supraviețuim. În ultimele capitole, ne îndepărtăm de detalii și privim problema mai largă pentru a acoperi situația globală care s-a dezvoltat ca urmare a studiului nostru. Vă aduc în atenție câteva recomandări cu privire la ceea ce ar trebui întreprins astăzi pentru a evita o catastrofă care să amenințe existența omenirii în viitor.

A scrie această carte nu a fost ușor. Sper ca calea pe care am parcurs-o să beneficieze alți cercetători. Vor ajunge la noi frontiere, fără obstacole inutile, și plini de energie se vor putea implica rapid în lucrare, datorită căreia oamenii sunt pe deplin conștienți de complexitatea problemei cu care se confruntă. (Dacă, cu toate acestea, viitorii analiști găsesc viitorii analiști oarecum înfășurați și plini de denivelări în unele locuri, sper că vor aprecia cât de impasibil a fost peisajul înainte.)

În ciuda dificultăților asociate lucrului la carte, am încercat să prezint materialul într-un limbaj accesibil; cu toate acestea, acum văd că nu m-am ocupat complet de acest lucru. Desigur, în timp ce scriam, vorbeam mental cu un potențial cititor și, din anumite motive, mi-am imaginat întotdeauna în acest rol, doar puțin mai tânăr decât prezentul - se dovedește că am făcut o carte care ar putea să trezească interesul în primul rând de la mine, dar nu împovărat de trăit. de-a lungul anilor. Poate că acest lucru va determina numărul mic de cititori în viitor. Cu toate acestea, în opinia mea, conținutul cărții va fi accesibil pentru mulți oameni. Este necesar doar să depunem eforturi mentale, să nu mai respingem noi idei la fața locului și să ne abținem de la tentația de a înlocui toate neînțelegerile cu stereotipuri convenabile pe care cu toții le scoatem cu ușurință din stocurile noastre culturale. Cititorii care nu au cunoștințe speciale nu trebuie să renunțe la calcule matematice și termeni necunoscuți în locurile în care se întâlnesc, deoarece contextul vă permite întotdeauna să înțelegeți ideea principală. (Cititorii care, dimpotrivă, vor să afle mai multe detalii, vor găsi multe lucruri interesante în note.1.)

Probabil, o mulțime de lucruri din carte sunt declarate incorect2. Poate că am trecut cu vederea unele considerații importante, în urma cărora unele dintre concluziile mele - și poate toate - se vor dovedi eronate. Pentru a nu rata cea mai mică nuanță și pentru a indica gradul de incertitudine cu care avem de-a face, a trebuit să apelez la markeri specifici - de aceea textul meu este supraîncărcat cu greșeli verbale atât de urâte ca „poate”, „ar putea”, „poate”, „pare” , "Probabil", "cu un grad ridicat de probabilitate", "aproape sigur". Cu toate acestea, de fiecare dată recurg la ajutorul cuvintelor introductive extrem de atent și foarte atent. Cu toate acestea, pentru a indica limitarea generală a presupunerilor epistemologice, un astfel de dispozitiv stilistic nu este în mod clar suficient; autorul trebuie să dezvolte o abordare sistematică pentru a raționa în condiții de incertitudine și a indica direct posibilitatea de eroare. Nu este în niciun caz o problemă de falsă modestie. Recunosc sincer că în cartea mea pot exista erori grave și concluzii incorecte, dar, în același timp, sunt convins că punctele de vedere alternative prezentate în literatură sunt și mai grave. Mai mult, aceasta se aplică și „ipotezei nule” general acceptate, conform căreia astăzi putem ignora absolut problema apariției supermindului și ne simțim complet în siguranță.

Capitolul unu

Realizări anterioare și oportunități de astăzi

Să începem prin abordarea trecutului îndepărtat. În termeni generali, istoria este o succesiune de modele de creștere diferite, procesul fiind accelerat progresiv în natură. Acest model ne dă dreptul să presupunem că este posibilă următoarea - chiar mai rapidă - perioadă de creștere. Cu toate acestea, este greu de acordat o importanță prea mare acestei considerente, deoarece subiectul cărții noastre nu este „accelerarea tehnologică”, nici „creșterea exponențială” și nici măcar acele fenomene care sunt prezentate de obicei sub conceptul de „singularitate”. În continuare, vom discuta istoria problemei: cum s-au dezvoltat cercetările privind inteligența artificială. Atunci să trecem la situația actuală: ce se întâmplă în acest domeniu astăzi. În cele din urmă, ne vom baza pe unele evaluări recente ale specialiștilor și vom vorbi despre incapacitatea noastră de a prezice calendarul evoluțiilor ulterioare.

Modele de creștere și istorie umană

În urmă cu doar câteva milioane de ani, strămoșii oamenilor locuiau încă în coroanele copacilor africani, sărind de pe ramură în ramură. apariție Homo sapienssau un om rațional, separat de strămoșii noștri comuni cu maimuțele, din punct de vedere geologic și chiar evolutiv, s-a întâmplat foarte bine. Persoanele antice au luat o poziție verticală, iar degetele de pe mâini au început să se ridice vizibil de restul. Totuși, cel mai important este că schimbările relativ nesemnificative au avut loc în volumul creierului și în organizarea sistemului nervos, ceea ce a dus la o descoperire gigantică a dezvoltării mentale umane. Drept urmare, oamenii au capacitatea de a gândi abstract. Au început nu numai să articuleze gânduri complexe, ci și să creeze o cultură a informației, adică să acumuleze informații și cunoștințe și să le transmită din generație în generație. Trebuie să spun, omul a învățat să facă asta mult mai bine decât oricare alte viețuitoare de pe planetă.

Omenirea antică, folosindu-se de abilitățile sale, a dezvoltat metode de producție din ce în ce mai raționale, datorită cărora a putut să migreze mult dincolo de junglă și savană. Imediat după apariția agriculturii, dimensiunea populației și densitatea acesteia au început să crească rapid. Mai mulți oameni - mai multe idei și densitate ridicată au contribuit nu numai la răspândirea rapidă a noilor tendințe, dar și la apariția diverșilor specialiști, ceea ce a însemnat că, printre oameni, a existat o îmbunătățire continuă a abilităților profesionale. Acești factori au crescut ritmul dezvoltării economice, a făcut posibilă creșterea productivității și formarea capacității tehnice. În viitor, același progres semnificativ care a dus la revoluția industrială a provocat un al doilea salt istoric în accelerarea ritmului de creștere.

O astfel de dinamică de creștere a avut implicații importante. De exemplu, în zorii omenirii, când strămoșii oamenilor moderni sau ai hominidelor au locuit pe Pământ, dezvoltarea economică a fost prea lentă și a fost nevoie de aproximativ un milion de ani pentru creșterea capacității de producție a populației planetei pentru a se permite să crească cu un milion de oameni, existând în pragul supraviețuirii. Și după revoluția neolitică, prin 5000 î.Hr. e. când umanitatea a trecut de la o societate de vânătoare și de adunare la un model economic agricol, rata de creștere a crescut atât de mult, încât două sute de ani au fost suficiente pentru aceeași creștere a populației. Astăzi, după revoluția industrială, economia globală este în creștere aproximativ la același ritm la fiecare oră și jumătate1.

Rata actuală de creștere - chiar dacă este molipsită pentru o perioadă relativ lungă de timp - va duce la rezultate impresionante. Să presupunem că economia mondială continuă să crească la o rată medie caracteristică din ultimii cincizeci de ani, la fel, populația lumii va deveni mai bogată în viitor decât astăzi: până în 2050 - de 4,8 ori și până la 2100 - de 34 de ori2.

Cu toate acestea, perspectivele unei creșteri exponențiale stabile se estompează în comparație cu ceea ce se poate întâmpla atunci când urmează o schimbare bruscă în lume, ritmul de dezvoltare al cărui semnificație și consecințe va fi comparabil cu revoluțiile neolitice și industriale. Potrivit economistului Robin Hanson, pe baza datelor istorice privind activitatea economică și populația, dublarea timpului economiilor societății de vânătoare și adunare pleistocene a fost de 224 de mii de ani, societatea agrară de 909 de ani, iar societatea industrială de 6,3 ani3. (În conformitate cu paradigma lui Hanson, un model economic modern, cu o structură mixtă agrar-industrială, nu se dezvoltă într-un ritm dublat la fiecare 6,3 ani.) Dacă în dezvoltarea mondială, un astfel de salt era deja comparabil în semnificația sa revoluționară cu cele două anterioare, atunci economia ar atinge un nou nivel și își va dubla rata de creștere aproximativ la fiecare două săptămâni.

Din punctul de vedere de astăzi, un astfel de ritm de dezvoltare pare fantastic. Dar și martorii epocilor trecute ar fi putut cu greu să sugereze că economia mondială s-ar dubla de mai multe ori pe parcursul unei singure generații. Ceea ce li s-a părut complet de neconceput este perceput de noi ca fiind norma.

Ideea abordării momentului singularității tehnologice a devenit extrem de populară după apariția unor lucrări inovatoare ale lui Vernon Wing, Ray Kurzweil și alți cercetători4. Cu toate acestea, conceptul de „singularitate”, care este folosit în diverse sensuri, a dobândit deja un sens stabil în spiritul utopianismului tehnologic și chiar a dobândit un halou de ceva nemaipomenit și în același timp destul de maiestuos5. Pentru că majoritatea definițiilor cuvântului singularitate nu sunt legate de subiectul cărții noastre, vom obține o claritate mai mare dacă vom scăpa de ea în favoarea unor termeni mai exacti.

Ideea care ne interesează în legătură cu conceptul de singularitate este un potențial inteligență explozivă, mai ales în perspectiva creării unui supermind artificial. Poate prezentat pe fig. 1 curbe de creștere îl vor convinge pe unul dintre voi că suntem pe punctul de a face un nou salt intensiv în ritmul dezvoltării - un salt comparabil cu revoluțiile neolitice și industriale. Cel mai probabil, este dificil pentru persoanele care au încredere în topuri să își imagineze un scenariu în care dublarea timpului economiei globale este redusă la săptămâni fără participarea unei minți super-puternice, care este de multe ori mai rapidă și mai rapidă decât mintea noastră obișnuită biologică. Cu toate acestea, nu este necesar să se exerseze curbele de creștere și extrapolarea ritmului istoric al dezvoltării economice pentru a începe să fie responsabil pentru apariția revoluționară a inteligenței artificiale. Această problemă este atât de gravă încât nu are nevoie de astfel de argumente. După cum vom vedea, există motive mult mai convingătoare pentru a exercita prudență.

Fig. 1. Dinamica PIB-ului mondial pe o lungă perioadă istorică. La scară liniară, istoria economiei mondiale este afișată ca o linie, mai întâi aproape fuzionându-se cu axa orizontală, apoi repezind brusc vertical în sus. A. Chiar extinzând limitele de timp până la zece mii de ani în trecut, vedem că linia crește o scuturare de la un anumit punct la aproape nouăzeci de grade. B. Linia se desparte vizibil de axa orizontală numai la nivelul aproximativ din ultima sută de ani. (Diferența dintre curbele din diagrame este explicată de un set de date diferite; prin urmare, indicatorii sunt oarecum diferiți unul de celălalt.6.)

Asteptari mari

De la inventarea primelor calculatoare electronice din anii 40, oamenii nu au încetat să prezică apariția unui computer, al cărui nivel de inteligență va fi comparabil cu cel uman. Aceasta se referă la un sistem tehnic rezonabil înzestrat cu bun-simț, care are capacitatea de a învăța și de a gândi, capabil să planifice și să proceseze informații colectate dintr-o varietate de surse - reale și teoretice. În acele zile, mulți se așteptau ca astfel de mașini să devină o realitate în douăzeci și 7 de ani. De atunci, timpul s-a schimbat cu o viteză de un an pe an, adică astăzi futurologii, convinși de probabilitatea creării de inteligență artificială, continuă să creadă că „mașinile inteligente” vor apărea peste câteva decenii8.

Termenul de douăzeci de ani este iubit de toți predicatorii schimbărilor fundamentale. Pe de o parte, acest lucru nu este prea lung - și, prin urmare, subiectul discuției atrage atenția largă; pe de altă parte, nu este atât de rapid încât face posibilă visarea la o serie de descoperiri științifice cele mai importante - deși ideile despre ele în momentul prognozei sunt foarte vagi, însă punerea lor în aplicare este practic în afara oricărei îndoieli. Să comparăm acest lucru cu perioadele de prognoză mai scurte stabilite pentru diferite tehnologii, care sunt destinate să aibă un impact semnificativ asupra lumii: de la cinci la zece ani - la momentul prognozei, majoritatea soluțiilor tehnice sunt deja parțial aplicate; cincisprezece ani - în momentul prognozei, aceste tehnologii există deja sub formă de versiuni de laborator. În plus, perioada de douăzeci de ani este cel mai adesea apropiată de durata medie a activității profesionale rămase a predatorului, ceea ce reduce riscul de reputație asociat cu predicția lui îndrăzneață.

Cu toate acestea, datorită așteptărilor prea mari și neîmplinite din anii trecuți, nu ar trebui să concluzionăm imediat că în principiu crearea inteligenței artificiale este imposibilă și că nimeni nu o va dezvolta vreodată9. Motivul principal pentru care progresul a fost mai lent decât cel anticipat se datorează problemelor tehnice întâlnite la dezvoltarea de mașini inteligente. Pionierii nu au prevăzut toate dificultățile cu care s-au confruntat. Și întrebările: sunt gravitatea acestor obstacole și cât de departe suntem de a le depăși - sunt încă deschise. Uneori, sarcinile care par inițial dificile fără speranță au o soluție surprinzător de simplă (deși mai des, poate, se întâmplă invers).

În capitolul următor, vom analiza modalitățile care pot duce la apariția inteligenței artificiale, nu inferioare omului. Dar acum aș dori să vă atrag atenția asupra unui aspect important. Vor fi multe opriri între actualul punct de plecare și viitor atunci când va apărea inteligența artificială, dar acest punct nu este în niciun caz stația de destinație finală. Aproape de următoarea oprire va fi stația „Overmind” - punerea în aplicare a inteligenței artificiale a unui nivel care nu este doar egal cu mintea umană, dar îl depășește semnificativ. După ultima oprire, trenul nostru se va accelera într-o asemenea măsură încât la stația „Omul” nu poate doar opri, dar chiar să încetinească. Cel mai probabil, el va fluiera. Matematicianul britanic Irving John Goode, care a lucrat în timpul celui de-al Doilea Război Mondial ca criptograf în echipa lui Alan Turing, a fost cel mai probabil primul care a prezentat cele mai importante detalii ale acestui scenariu. În articolul său citat frecvent din 1965 despre primele mașini superinteligente, el a scris: